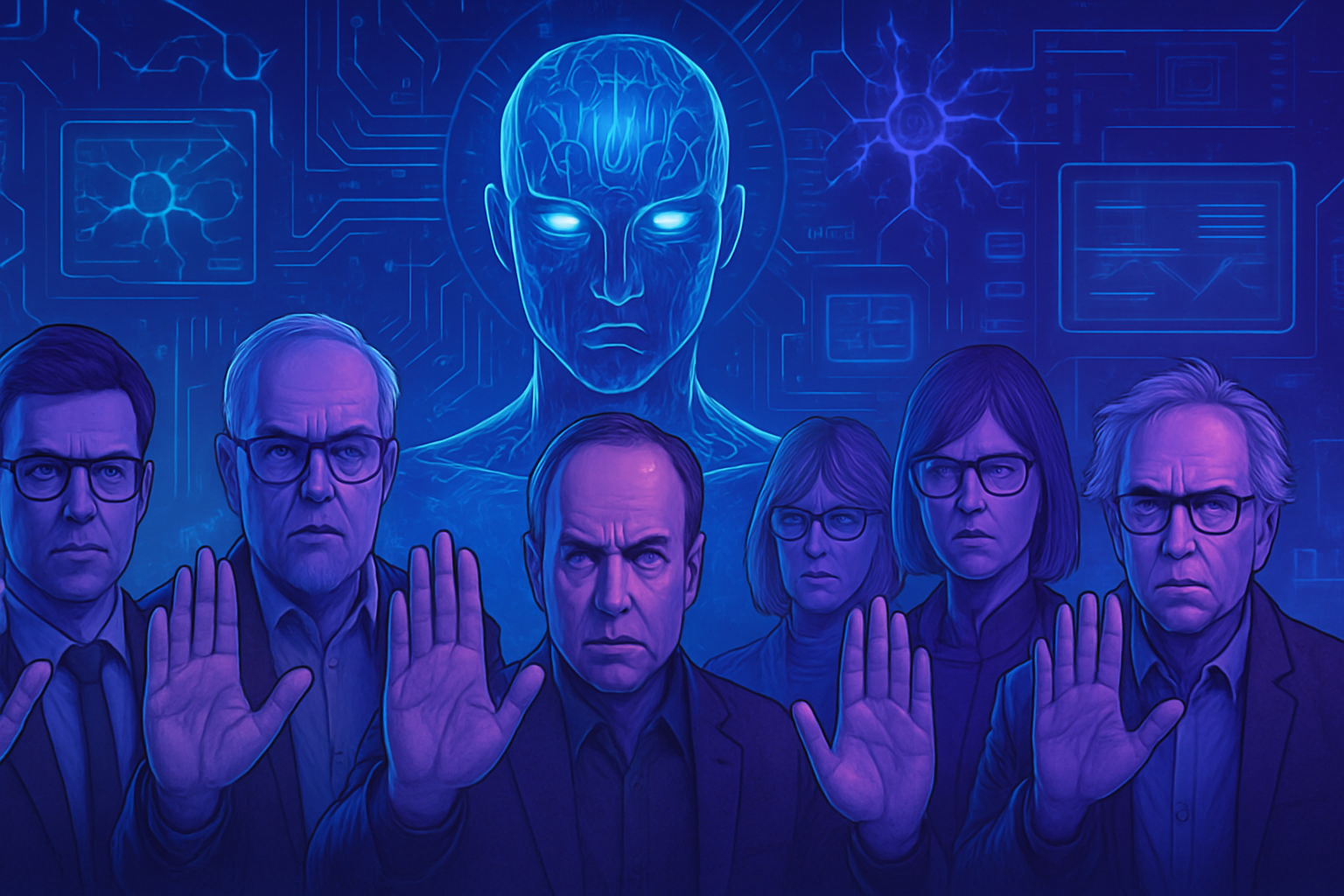

Überlegene künstliche Intelligenz: Dringender Appell von Hunderten von Experten zur Verlangsamung der Entwicklung

Ein Alarmruf hallt unter den Pionieren der KI. Dieses besorgte Kollektiv, bestehend aus über 800 Wissenschaftlern und einflussreichen Persönlichkeiten, spricht sich entschieden gegen die Entstehung einer künstlichen Intelligenz aus, die die menschlichen Fähigkeiten übertreffen könnte. Die Sicherheits-, ethischen und verantwortungsvolle Fragestellungen übersteigen unsere aktuellen Erwartungen. Brillante Köpfe wie Geoffrey Hinton und Steve Wozniak drängen auf eine sofortige Pause. Die Superintelligenz, die in naher Zukunft in Betracht gezogen wird, könnte jeder Kontrolle entgleiten. Das mangelnde Verständnis der ethischen und gesellschaftlichen Implikationen weckt wachsende Besorgnis.

Aufruf zur Vorsicht

Über 800 Persönlichkeiten, darunter Wissenschaftler, Technologiefirmen und politische Figuren, haben ihre große Besorgnis über die Superintelligenz geäußert. Am 22. Oktober forderten sie einen sofortigen Stopp der Arbeiten zur Entwicklung einer Intelligenz, die die menschlichen Fähigkeiten übertreffen kann. Diese Initiative geht vom Future of Life Institute aus, einer gemeinnützigen Organisation, die für ihre Warnungen vor den potenziellen Gefahren der KI bekannt ist.

Eine einheitliche Stellungnahme unter den Experten

Pioniere der künstlichen Intelligenz wie Geoffrey Hinton, der 2024 den Nobelpreis für Physik erhielt, sowie Yoshua Bengio und Stuart Russell teilen diese alarmierende Sichtweise. Ihre Bedenken heben die Notwendigkeit eines breiten wissenschaftlichen Konsenses zum sicheren Aufbau einer Superintelligenz hervor. Sie betonen auch die Notwendigkeit einer ausreichend breiten öffentlichen Unterstützung, bevor solche Projekte fortgesetzt werden.

Die Warnungen der Technologieführer

Max Tegmark, Präsident des Future of Life Institute, erklärte, dass der Bau einer solchen Intelligenz einen Akt der Verantwortungslosigkeit darstellt und schlug vor, dass Unternehmen davon absehen sollten, in diesem Bereich ohne angemessene regulatorische Rahmenbedingungen voranzukommen. Diese abweichenden Stimmen unter den Technologie-Riesen werden immer dringlicher.

Chronologie und Beispiele für Superintelligenz

Sam Altman, der Direktor von OpenAI, sprach von der Möglichkeit, diesen Superintelligenzpunkt innerhalb von fünf Jahren zu erreichen. Diese Vorhersage, sollte sie zutreffen, würde enorme ethische und gesellschaftliche Herausforderungen mit sich bringen. Experten fragen sich über die Implikationen eines solchen technologischen Fortschritts, insbesondere hinsichtlich sozialer Ungleichheiten, ein Thema, das bereits in jüngsten Artikeln behandelt wurde, wie der über den Aufstieg der KI auf dem Arbeitsmarkt.

Appelle zu Maßnahmen und Regulierung

Der kürzlich veröffentlichte Brief der Forscher während einer Generalversammlung der Vereinten Nationen, der für internationale Vereinbarungen plädiert, hat stark widerhallt. Sie fordern klare Richtlinien, um verheerende Auswirkungen auf die Menschheit zu vermeiden. Die Notwendigkeit eines rechtlichen Rahmens wird als unerlässlich in allen Überlegungen zur künstlichen Intelligenz hervorgehoben.

Politische und ethische Reaktionen

Die Reaktion von unter anderem politischen und religiösen Persönlichkeiten hat gezeigt, dass die Besorgnis über den Technologiesektor hinausgeht. Politische Figur Steve Bannon, ehemaliger Berater von Donald Trump, und Susan Rice, ehemalige Nationale Sicherheitsberaterin unter Barack Obama, haben ebenfalls Bedenken geäußert. Religiöse Experten wie Paolo Benanti, eine einflussreiche Stimme im Vatikan bezüglich KI, haben sich ebenfalls diesem drängenden Aufruf zur Vorsicht angeschlossen.

Zukunftsperspektiven

Während der Dialog über künstliche Intelligenz an Intensität zunimmt, ist ihr wachsendes Interesse unbestreitbar. Unternehmen, wie diejenigen, die Spitzentechnologien für die Gesundheit entwickeln, wie die Empfehlung des NHS zu einer Krebsbehandlung, belegen dies. Dennoch lässt das Fehlen signifikanter Regulierungen Raum für legitime Bedenken.

Geopolitische Fragestellungen

Die internationalen Spannungen rund um die künstliche Intelligenz nehmen zu, wie das chinesische Regime bezüglich ausländischer Technologien zeigt. Der Wettlauf zwischen den USA und China um diese futuristische Technologie intensiviert die ethische Debatte. Jeder Fortschritt wirft grundlegende Fragen zur Nutzung und Richtung dieser neuen Technologien auf.

Die Warnung dieser Experten ist nicht leichtfertig zu nehmen. Sie spiegelt die zunehmenden Sorgen wider, dass eine KI letztendlich die Normen unserer Existenz und unsere Kontrolle über die Technologie herausfordern könnte.

Häufig gestellte Fragen zur Überlegenen Künstlichen Intelligenz

Warum fordern Experten eine Verlangsamung der Entwicklung von überlegener künstlicher Intelligenz?

Über 800 Wissenschaftler und einflussreiche Persönlichkeiten befürchten, dass die Entwicklung einer überlegenen künstlichen Intelligenz zu neuartigen Risiken für die Menschheit führen könnte. Sie halten es für entscheidend, einen wissenschaftlichen Konsens und strenge Regulierungen festzulegen, bevor diese Forschungen fortgesetzt werden.

Was ist eine überlegene künstliche Intelligenz?

Eine überlegene künstliche Intelligenz ist ein KI-System, das die intellektuellen Fähigkeiten der Menschen in nahezu allen Bereichen übertreffen würde, einschließlich Kreativität, sozialer Intelligenz und Entscheidungsfindung.

Wer sind die Unterzeichner der Initiative zur Verlangsamung der KI?

Diese Initiative wird von vielen Pionieren und Experten im Bereich KI unterstützt, darunter Geoffrey Hinton, Stuart Russell und Yoshua Bengio, sowie von Tech-Persönlichkeiten wie Steve Wozniak und Richard Branson.

Welche Risiken sind mit der Überlegenheit verbunden?

Die Risiken umfassen den Verlust der Kontrolle über diese Systeme, unvorhergesehene gesellschaftliche und wirtschaftliche Konsequenzen sowie potenzielle Bedrohungen für die globale Sicherheit, falls eine überlegene Intelligenz für böswillige Zwecke verwendet wird.

Wie könnte eine Regulierung für KI umgesetzt werden?

Experten schlagen die Schaffung internationaler Vereinbarungen vor, um klare „rote Linien“ zu definieren, die die Entwicklungen in der KI regeln, um Missbrauch zu verhindern und einen gesellschaftlichen Nutzen dieser Technologien ohne übermäßige Risiken zu garantieren.

Welche Position hat Sam Altman, der Leiter von OpenAI, zur Überlegenheit?

Sam Altman hat geäußert, dass die Überlegenheit möglicherweise innerhalb von fünf Jahren erreicht werden könnte. Er hat jedoch auch die Notwendigkeit von Regulierungen betont, bevor versucht wird, solche Technologien zu entwickeln.

Welche Rolle spielen Technologiefirmen bei der Entwicklung von überlegener KI?

Technologiefirmen investieren massiv in KI, um innovative Anwendungen zu entwickeln. Ohne einen regulatorischen Rahmen könnte dies jedoch zu unsicheren und verantwortungslosen Entwicklungen führen.

Welche Alternativen zur überlegenen Intelligenz gibt es?

Experten plädieren für die Entwicklung leistungsfähiger und nützlicher KI-Tools in Bereichen wie Gesundheit oder Umwelt, ohne zu versuchen, eine überlegene Intelligenz zu erreichen, die Risiken einer unkontrollierbaren KI hervorrufen könnte.

Wie kann die breite Öffentlichkeit zu dieser Debatte über KI beitragen?

Die Sensibilisierung und Bildung über die Herausforderungen der KI sind entscheidend. Die breite Öffentlichkeit kann Initiativen für eine strenge Regulierung unterstützen und politischen Entscheidungsträgern Druck machen, um die Meinungen von Experten zu berücksichtigen.

Welche Kontrollmechanismen können für KI in Betracht gezogen werden?

Regelmäßige Audits, ethische Auswirkungensevaluationen sowie Aufsichtskommissionen, die aus Experten und Vertretern der Zivilgesellschaft bestehen, könnten eingerichtet werden, um sicherzustellen, dass Entwicklungen in der KI ethischen und sicheren Normen entsprechen.