Die seltsame Empfehlung der Google-KI

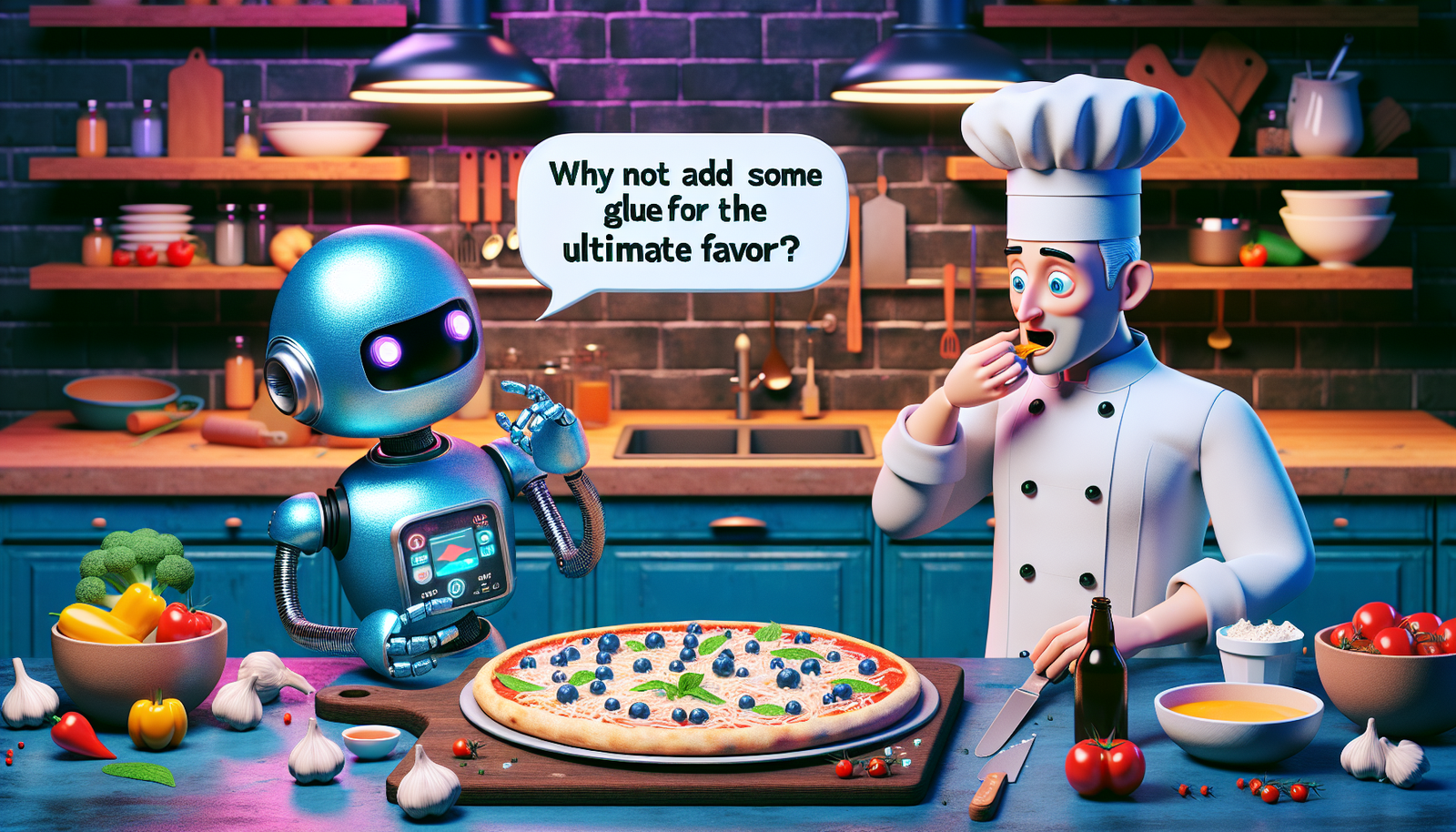

Eine zumindest ungewöhnliche Frage ist im Internet aufgetaucht: „Wie kann man Käse auf der Pizza festkleben?“ Als ein amerikanischer Internetnutzer Google dazu befragte, sorgte die Antwort, die von der auf dem Modell AI Overview basierenden künstlichen Intelligenz gegeben wurde, für Aufregung. Die KI schlug vor, etwa 25 ml ungiftigen Kleber zur Sauce hinzuzufügen, um die Haftung des Käses zu verbessern.

Eine virale Reaktion in den sozialen Medien

Er schockiert von einer solchen Empfehlung, teilte der Nutzer schnell einen Screenshot dieser Antwort auf X, früher bekannt als Twitter. Dieser Beitrag verbreitete sich rasch in den sozialen Medien und sorgte für einen wahren Aufschrei. Tausende von Internetnutzern fragten sich, ob Google versuche, gefährliche Praktiken in der Küche zu fördern.

Eine amüsante Referenz zu Reddit

Bei der Untersuchung dieser Situation stellte Le HuffPost fest, dass der erstaunliche Ratschlag aus einem humorvollen Beitrag auf Reddit stammte. Dieser Beitrag, datierend aus dem Jahr 2013, empfahl fiktiv, Kleber zu verwenden, um die Pizza-Soße klebriger zu machen. Google gab zu, dass seine AI Overview diese Information wortwörtlich übernommen hatte, ohne den feinen Sinn dahinter zu verstehen.

Die Kontroversen um die Informationsquellen

Dieses Missgeschick wirft ein Licht auf das Problem der von der KI verwendeten Quellen. Google räumte ein, dass dieser Rat aus einer untypischen Anfrage stammte, die wenig repräsentativ für die üblichen Nutzeranfragen ist. Meghann Farnsworth, die Sprecherin von Google, erklärte, dass diese Einzelfälle analysiert werden, um die Zuverlässigkeit der AI Overview zu verbessern.

Die Gefahren von KI-Ernährungsempfehlungen

Heute ist allgemein bekannt, dass künstliche Intelligenzen manchmal „halluzinieren“, das heißt, sie nehmen sich Freiheiten mit der Wahrheit, um ihre Antworten zu rechtfertigen. In diesem speziellen Fall beschränkt sich Gemini, die KI von Google, jedoch nicht darauf, Ratschläge zu erfinden. Das wörtliche Zitat aus dem Reddit-Beitrag hat die grundlegende Frage nach der Qualität und der Wahrhaftigkeit der Quellen im Internet aufgeworfen.

Besorgniserregende Präzedenzfälle

Es ist nicht das erste Mal, dass eine künstliche Intelligenz im Bereich Ernährung Bedenken aufwirft. Im August 2023 wurde ein neuseeländischer Rezeptgenerator wegen zweifelhafter Vorschläge in die Kritik geraten, einschließlich Gerichte, die mit Bleichmittel oder Gift zubereitet wurden. Das Fehlen menschlicher Aufsicht in diesen Systemen führt zu ähnlichen Risiken.

Ein sich veränderndes technologisches Landschaft

Angesichts des Aufschwungs künstlicher Intelligenzen bleibt die Frage ihrer Zuverlässigkeit im öffentlichen Diskurs zentral. Die großen Sprachmodelle werden von umfangreichen und vielfältigen Datenbanken gespeist, die jedoch manchmal wenig zuverlässig sind. Diese Realität unterstreicht die Notwendigkeit einer Regulierung und einer verstärkten Wachsamkeit. Die Auswirkungen auf unsere Jugend und auf unsere kulinarische Kultur verdienen besondere Aufmerksamkeit.

Die Implikationen dieses Vorfalls sind weitreichend und sprechen alle beteiligten Parteien an, seien es Konsumenten oder Technologieunternehmen. Es bleibt abzuwarten, wie diese Ereignisse die künftigen Entwicklungen der künstlichen Intelligenz in so entscheidenden Bereichen wie Gesundheit und Kochen beeinflussen werden.

Häufig gestellte Fragen

Warum hat Google empfohlen, Kleber auf meine Pizza zu geben?

Die seltsame Empfehlung stammt von der AI Overview-Funktion von Google, die einen humorvollen Beitrag auf Reddit zitiert hat. Die KI hat dies wörtlich interpretiert, was zu dieser absurden Vorschlag führte.

Ist diese Antwort ein Scherz oder ein Fehler der künstlichen Intelligenz?

Es ist ein Fehler. Die KI hat eine humorvolle Information wiedergegeben, ohne den feinen Sinn zu verstehen. Dies verdeutlicht die Grenzen von künstlichen Intelligenzen bei der Kontextinterpretation.

Welche Maßnahmen ergreift Google, um solche gefährlichen Ratschläge zu vermeiden?

Google hat erkannt, dass diese Vorfälle aus ungewöhnlichen Anfragen stammen und hat erklärt, dass sie diese Fehler nutzen, um ihre Systeme zu verbessern und zukünftige absurde Empfehlungen zu verhindern.

Welche Implikationen haben solche Empfehlungen der KI im kulinarischen Bereich?

Unangemessene Empfehlungen können Sicherheitsrisiken in der Ernährung hervorrufen. Dies unterstreicht die Notwendigkeit menschlicher Aufsicht über die von der KI generierten Antworten, insbesondere bei kulinarischen Ratschlägen.

Wie funktioniert die KI von Google, wenn sie Empfehlungen gibt?

Google nutzt KI-Modelle, die riesige Daten analysieren, um Antworten zu generieren. Sie können jedoch manchmal Informationen falsch interpretieren, wie es hier der Fall war.

Kann man anderen kulinarischen Empfehlungen von Google vertrauen?

Obwohl Google oft nützliche Ratschläge gibt, ist es wichtig, die Empfehlungen zu überprüfen, insbesondere in sensiblen Bereichen wie der Gastronomie, wo Fehler gefährlich sein können.

Gab es andere Beispiele für riskante Empfehlungen der Google-KI oder ähnlicher Systeme?

Ja, die KI hat bereits besorgniserregende Empfehlungen abgegeben, wie Rezepte mit giftigen Zutaten. Dies unterstreicht die Wichtigkeit menschlicher Einschätzung der von der KI generierten Vorschläge.

Wie können Nutzer eine seltsame Empfehlung von Google melden?

Nutzer können unangemessene Ergebnisse über die von Google bereitgestellten Feedback-Tools melden, was hilft, die Algorithmen zu verbessern und mögliche Wiederholungen zu vermeiden.