L’émergence de l’IA, représentée par des géants tels que DeepSeek, transforme le paysage numérique, mais suscite des inquiétudes majeures. Les responsables de la sécurité perçoivent cette technologie comme une menace croissante pour l’intégrité de leurs systèmes. Les enjeux éthiques et sécuritaires se cristallisent autour de la gestion des données, mettant en exergue le besoin urgent de régulation gouvernementale. Face à un panorama de menaces de plus en plus sophistiquées, la tension monte et appelle à une réflexion collective sur les politiques à adopter. La coexistence pacifique avec l’IA requiert une attention singulière aux implications sécuritaires qu’elle entraîne.

Perturbations dans le paysage numérique

Les inquiétudes grandissent parmi les directeurs de la sécurité de l’information, notamment face à l’émergence de DeepSeek, une plateforme d’intelligence artificielle (IA) développée par un géant chinois. Cette technologie, qui promet des gains d’efficacité pour les entreprises, soulève des réticences parmi ceux chargés de défendre les infrastructures critiques. L’impact de cette innovation sur la cybersécurité devient une préoccupation majeure.

Appels à une régulation gouvernementale

Une enquête récente révèle que 81 % des CISOs britanniques estiment que la chatbot IA nécessite une régulation immédiate de la part du gouvernement. Les responsables de la sécurité redoutent qu’en l’absence d’interventions rapides, DeepSeek ne devienne un catalyseur de crises cybersécuritaires de grande envergure. Cette perception ne relève pas de spéculations, mais plutôt d’un constat des pratiques de gestion des données et des risques potentiels associés.

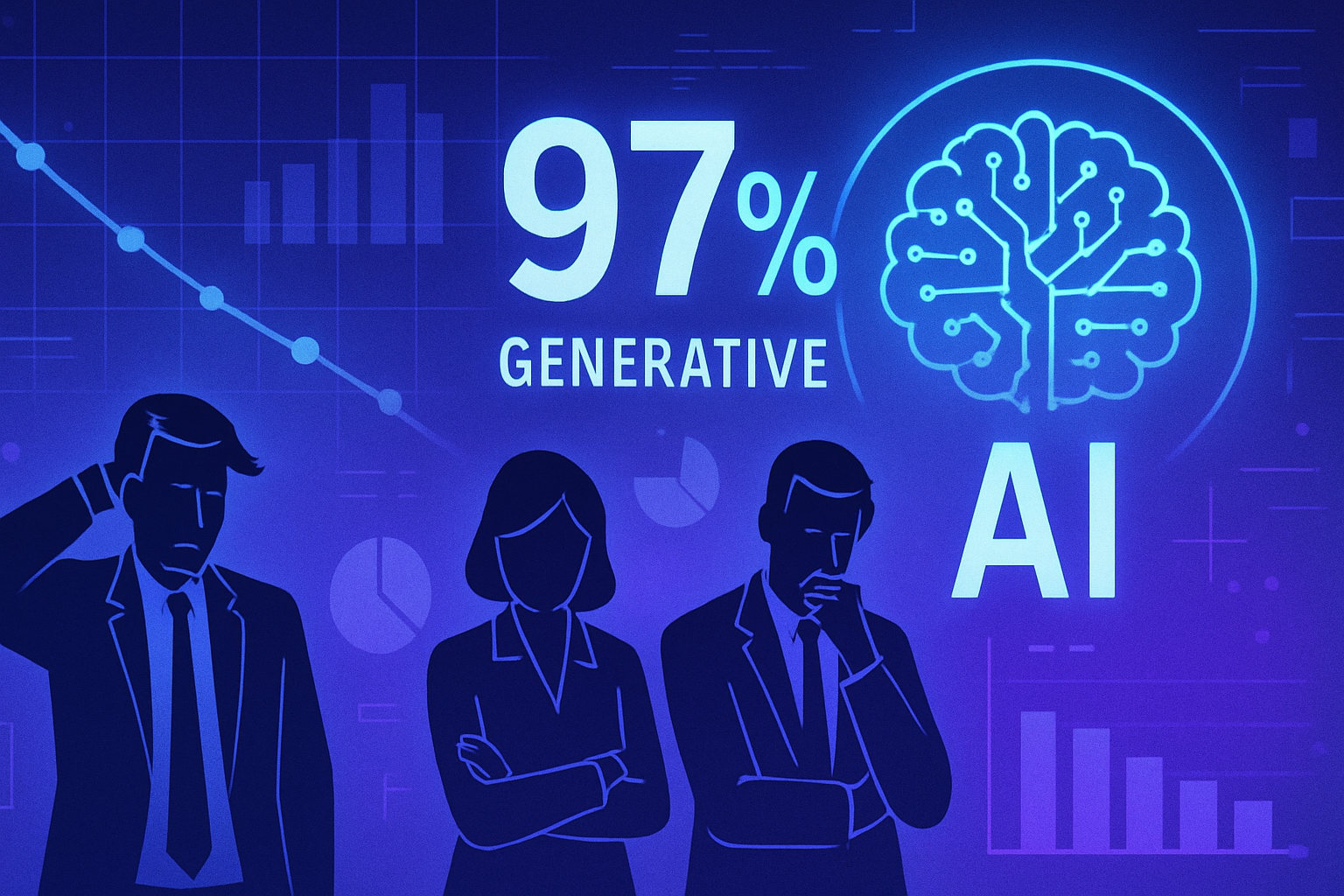

Réactions des responsables de la sécurité

Face à ces enjeux, 34 % des CISOs ont décidé d’interdire complètement les outils d’IA à cause des menaces qu’ils représentent pour leur sécurité. Une proportion conséquente, près de 30 % des responsables, a déjà stoppé des déploiements spécifiques d’IA au sein de leurs organisations. Ce retrait témoigne d’une réaction pragmatique face à un environnement cybernétique de plus en plus hostile.

Menaces grandissantes dues à l’IA

Les plateformes comme DeepSeek posent des dangers notables, exposant des données sensibles aux cybercriminels. Ainsi, 60 % des CISOs préviennent d’une augmentation directe des cyberattaques en raison de la prolifération de cette technologie. Ce constat amène de nombreux responsables à reconsidérer la façon dont ils intègrent l’IA dans leurs systèmes de sécurité.

Réelle incapacité à gérer les menaces

Un constat alarmant émerge : près de 46 % des leaders en sécurité admettent ne pas être préparés à gérer les menaces uniques engendrées par des attaques basées sur l’IA. Ils observent que les avancées des outils comme DeepSeek surpassent leurs capacités de défense en temps réel. Ce décalage crée une vulnérabilité potentiellement catastrophique pour les entreprises.

Investissements stratégiques dans l’IA

Malgré des mesures restrictives, les entreprises ne renoncent pas complètement à l’IA. Elles adoptent plutôt une approche stratégique, souhaitant intégrer cette technologie tout en se prémunissant contre les risques. 84 % des organisations britanniques considèrent l’embauche de spécialistes en IA comme une priorité pour les années à venir, indiquant un engagement clair en faveur d’une adoption responsable.

Partenariat avec les pouvoirs publics

Les dirigeants de la sécurité au Royaume-Uni ne visent pas à contrarier l’innovation de l’IA, mais souhaitent plutôt encadrer son développement. La nécessité d’un partenariat plus solide avec le gouvernement devient évidente. Ils plaident pour l’établissement de règles claires concernant le déploiement et la surveillance des technologies d’IA, en particulier face aux menaces émergentes telles que DeepSeek.

Urgence d’une réglementation adéquate

Les CISOs insistent sur l’absolue nécessité de définir un cadre réglementaire national, garantissant que cette technologie demeure un vecteur de progrès et non de crise. Les appels se multiplient pour une régulation efficace, alignée avec les besoins croissants de protection des données dans tous les secteurs. Ils souhaitent voir une structure garante d’une utilisation sécurisée de l’IA.

Initiatives en cours

Les responsables de la sécurité surveillent également les développements au sein de l’Union Européenne, qui œuvre à la mise en place d’une régulation robuste de l’IA capable de répondre à ces enjeux. Des initiatives de réglementation, comme celles discutées lors du récent sommet de Bletchley Park, visent à établir des normes équilibrées pour l’avenir de l’intelligence artificielle.

Exemples de régulation dans d’autres régions

À l’échelle mondiale, des pays comme les États-Unis renforcent leurs restrictions, par exemple, en limitant l’accès à certains outils d’IA par des acteurs étrangers. Par ailleurs, un renforcement des restrictions pourrait également contribuer à protéger l’intégrité des systèmes d’information en évitant que des technologies potentiellement dangereuses ne soient utilisées pour compromettre la sécurité nationale.

Réflexions sur des outils d’IA innovants

Des avancées telles que la présentation récente de Génie 3 par Google illustrent les évolutions fascinantes de l’IA. Ces innovations ouvrent des perspectives tout en soulevant des interrogations sur leur encadrement éthique et sécuritaire. Les préoccupations des leaders en cybersécurité rappellent que l’exploration de nouveaux horizons technologiques doit s’accompagner d’une vigilance accrue.

Les discussions évoquées dans le cadre des récentes conférences, comme le rendez-vous sur la régulation de l’IA, soulignent la nécessité de trouver un juste milieu entre innovation et précaution. Une approche équilibrée doit être adoptée pour garantir un avenir numérique capable de se développer sans compromettre la sécurité des données.

Face à un environnement technologique en constante évolution, les entreprises considèrent les enjeux de l’intelligence artificielle avec une gravité accrue. Une orchestration harmonieuse entre innovation et réglementation est essentielle pour éviter des dérives catastrophiques et assurer un avenir sûr pour tous.

Foire aux questions sur l’appel à la régulation urgente de l’IA comme DeepSeek

Pourquoi les responsables de la sécurité craignent-ils une crise nationale liée à DeepSeek ?

Les responsables de la sécurité estiment que DeepSeek, avec ses pratiques de gestion des données et son potentiel d’usage abusif, pourrait devenir un facteur déclencheur de cyberattaques à grande échelle, menaçant ainsi les données sensibles des entreprises et la sécurité nationale.

Quels sont les principaux risques associés à l’usage de l’IA comme DeepSeek ?

Les risques incluent l’exposition de données d’entreprise sensibles, le détournement de la technologie par des cybercriminels, et un impact négatif sur les cadres de gouvernance et de protection de la vie privée.

Quel est l’avis des CISOs sur la régulation gouvernementale concernant l’IA ?

Une majorité des CISOs appelle à une régulation urgente de l’IA pour établir des directives claires sur son déploiement, sa gouvernance et sa surveillance afin de prévenir les menaces potentielles et de renforcer la sécurité.

Comment les entreprises réagissent-elles face à l’émergence d’outils IA comme DeepSeek ?

Les entreprises adoptent une approche prudente en interdisant certains outils IA, tout en investissant dans la formation et le recrutement de spécialistes en IA pour naviguer en toute sécurité dans ce paysage technologique complexe.

Quelles mesures de préparation sont nécessaires pour faire face aux attaques alimentées par l’IA ?

Il est crucial de renforcer les cadres de cybersécurité existants, de former les équipes à la gestion des menaces spécifiques liées à l’IA, et de collaborer avec le gouvernement pour établir des normes de sécurité cohérentes.

Pourquoi certaines entreprises choisissent-elles d’interdire l’utilisation d’outils d’IA ?

Les préoccupations concernant la cybersécurité et le potentiel de manipulation de ces outils incitent certaines entreprises à interdire leur utilisation pour protéger leurs données et leurs infrastructures.

Quel impact les invités asiatiques, comme ceux de DeepSeek, pourraient-ils avoir sur les entreprises au Royaume-Uni ?

Les outils asiatiques, tels que DeepSeek, sont perçus comme de potentielles sources de vulnérabilités pour les entreprises du Royaume-Uni, ce qui alimente les inquiétudes quant à leur capacité à résister aux cybermenaces exacerbées.