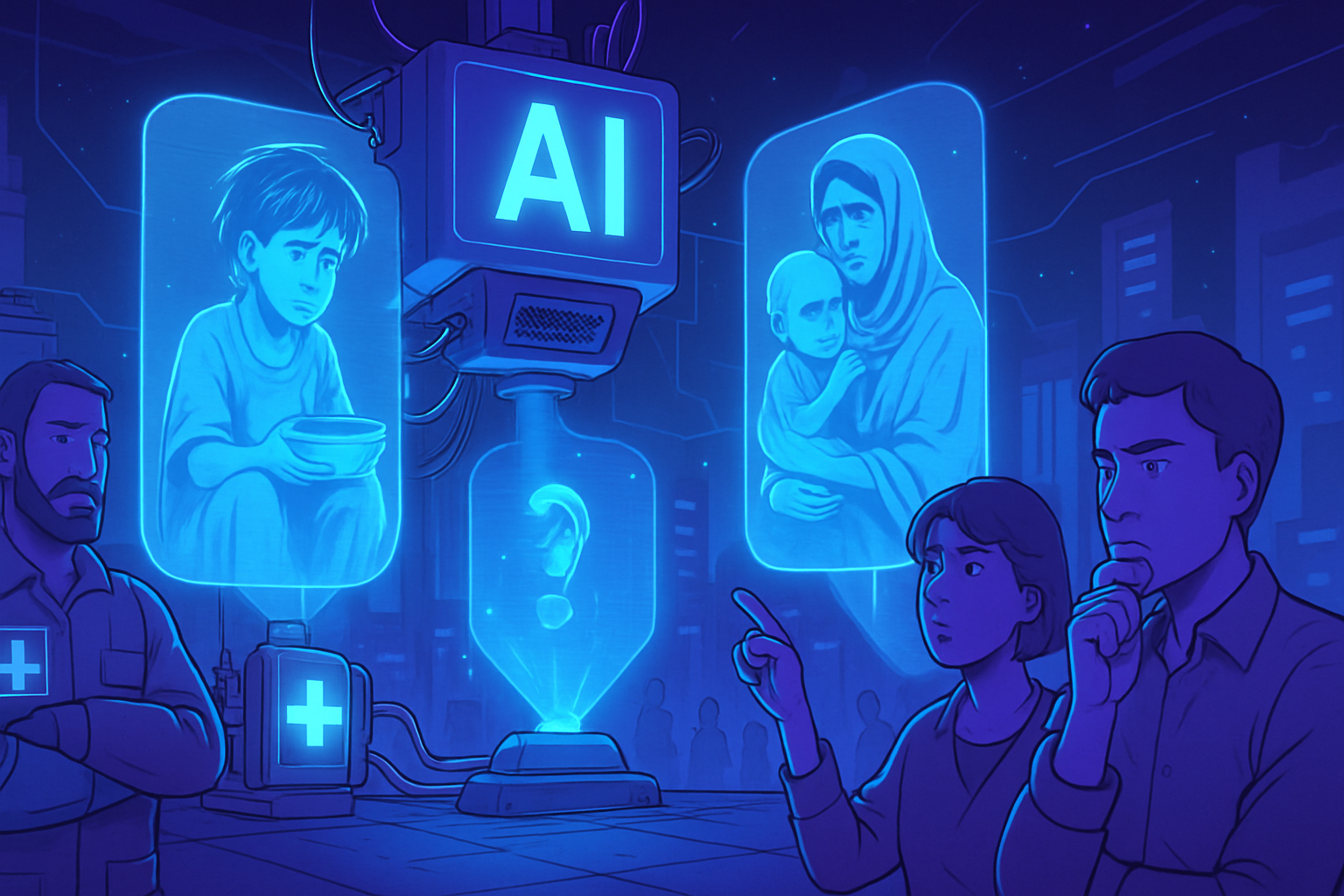

人道的な組織は大きな倫理的ジレンマに直面しています。貧困のイメージの操作は、人工知能によってますます懸念が高まっています。まるで二刀流の剣のように、これらの画像は人間の苦しみの可視性を強化しつつ、悲惨さと搾取の非難を引き起こしています。批判者は、受益者に対するステレオタイプ的かつ歪曲された表現を指摘し、現代の実践の道徳性に関する議論を増幅しています。主題の人間性はアルゴリズムの冷たさと衝突し、テクノロジーによって形作られた世界における視覚表現の倫理についての深い考察を引き起こします。

貧困の画像におけるAIの使用に対する批判

人道的な組織は、そのキャンペーンで人工知能(AI)によって生成された画像の使用に対して、ますます多くの批判に直面しています。これらの画像は、貧困と困窮している人々のニーズを示すためのものであるが、その信憑性に関して倫理的な疑問を引き起こします。批判者は、この実践が現実を歪め、潜在的な寄付者を誤解させる可能性があると示唆しています。

人道的機関への新たな脅威

誤解を招く画像の問題は、懸念すべき現象を浮き彫りにします。一部の人道的機関は、苦境の状況を描写するためにデジタル制作物を利用しており、寄付者の感情を操作しているとの非難を引き起こしています。この歪んだ認識は、資金提供のために公衆の信頼に依存するこれらの組織の信用に潜在的に悪影響を及ぼす可能性があります。

人道的ミッションへの影響

貧困の視覚化におけるAIの使用は、現場でのミッションに直接的な影響を及ぼします。組織は、歪んだ現実の表現に対して寄付者が錯覚を抱くことで、寄付者からの経済的支援を失うリスクを負っています。さらに、地球規模の問題に関するコミュニケーションが不十分すれば、現在の運営で行き詰まることにもつながります。

迅速かつ決定的な反応の必要性

この課題に直面して、迅速かつ決定的に反応する必要が極めて重要です。組織は、使用される画像が本物であり、現実を代表していることを保証するために厳格なプロトコルを設けるべきです。気候問題や武力紛争はこの状況をさらに複雑にし、寄付者の信頼を維持するために透明性がますます重要になります。人道的枠組みの中でのAIの影響に関する分析はこちらをご覧ください。

AIによって生成された画像が公衆の認識に及ぼす影響

AIによって作成された画像は魅力的かもしれませんが、それが公衆の認識に与える影響は懸念されるべきものです。これらの画像が簡単に操作できることは、本当の人間の苦しみに対する鈍感さを生じさせるリスクがあります。明確さと信憑性が保持されるべきであり、人道的組織と公衆との間に本物のつながりを維持するための要素です。この現象の影響に関する詳細はこちらをご覧ください。

歪んだ画像の危険性:ショッキングな例

最近、ガザの理想的な様子を描くファンタジー映像が問題となり、生成された画像がもたらす危険性を浮き彫りにしました。このような表現は、住民が直面している劇的な状況を軽視することで、公共の議論の中で視覚表現の倫理に関する問題を再浮上させるリスクがあります。さらなる分析は、こちらの記事で見つけることができます。

脆弱な人々の保護に関する課題

人道的な組織が脆弱な人々の保護のために闘い続ける中、AIによる画像の使用は、描かれる人口への影響についても疑問を投起してます。偽りの楽観的な画像が政策決定を誤らせ、不適切な介入を引き起こす可能性があります。ガザのイスラエル・パレスチナ問題のような紛争の厳しい現実は、真の共感と実際の介入を引き起こすために忠実な表現を求めます。この悲劇的な現実に関する詳細はこちらにあります。

真実性の重要性に関する結論

AIによって生成された画像に対する批判は、透明性のあるコミュニケーション戦略の重要性を強調しています。人道的な組織は、寄付者との信頼を保証し、人道的危機の表現において正確性を確保するために真実の情報を提供する責任を持つべきです。忠実な representationを確保することは、人道的課題に対する国際的な動員を強化することにもつながります。

AIによる貧困の画像と人道的組織に関するFAQ

AIによって生成された画像の使用に関して人道的組織への主な批判は何ですか?

批判は、しばしば信憑性の欠如、受益者へのスティグマ化のリスク、認識を促進するために貧困をエクスプロイトする傾向に集中しています。これは現実を歪める可能性があります。

人道的組織は、受益者の表現において非人間化を避けるために何ができるでしょうか?

コンテンツ作成に地域社会を巻き込み、画像が人々の尊厳を反映していることを確認し、貧困に関連するステレオタイプを使用しないようにします。

人道的な分野でのAIの画像使用に関する特定の規制やガイドラインはありますか?

現時点では普遍的な法律はありませんが、多くの組織が倫理的なガイドラインに基づいて、責任ある実践を確立するために人権擁護団体と協力しています。

AIによって生成された画像は、本当に人道的行動の公衆の認識にポジティブな影響を与えることができますか?

はい、適切に使用される場合、AIによって生成された画像は原因を人間化し、受益者の生涯の物語を公衆にとってよりアクセス可能で魅力的にすることがあります。

募金キャンペーンにおけるAI生成の貧困画像の使用の倫理的含意は何ですか?

倫理的な含意には、受益者を尊重して表現する責任、感情的操作を避けること、および集めた資金が適切に使用されることの保証が含まれます。

人道的な組織は、AIの使用と受益者の本物の物語をどのようにバランスを取るべきですか?

人を中心にしたアプローチを採用し、実体験の物語や本物の証言を組み込むことで、AIを受益者の声の補完的なツールとして使用します。

脆弱な人々の経験を軽視しないために、組織が避けるべき画像のタイプは何ですか?

過度の苦痛を示す画像やネガティブなステレオタイプ、さらにセンセーショナリズムのために貧困を搾取する画像は避けるべきです。個人をその状況に還元しないようにするためです。

人道的組織は、AIによって生成された画像の使用について完全に透明性を持つべきですか?

はい、透明性は公衆と受益者との信頼を築くために重要であり、これらの技術の使用や編集上の選択について明確にコミュニケーションすることが重要です。