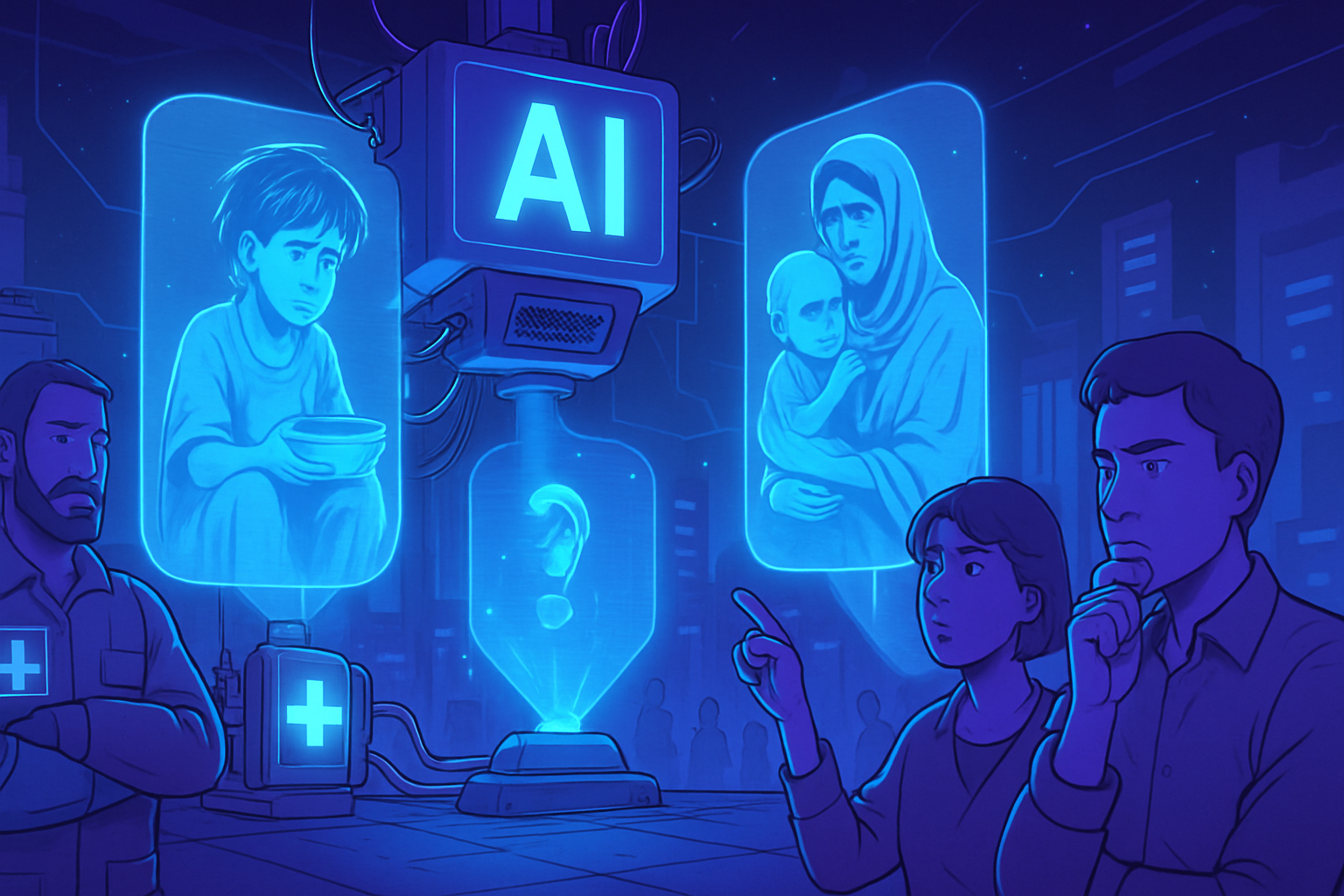

人道组织面临一个重大伦理困境。贫困形象的操控通过人工智能引发越来越多的担忧。这些图像就像双刃剑,既增强了人类苦难的可见性,又引发了悲惨主义和剥削的指责。批评者指出了受益者的刻板印象和扭曲表现,进一步加剧了对当代实践伦理的辩论。主题的人性与算法的冷酷相碰撞,引发了对在一个由技术塑造的世界中视觉伦理的深刻思考。

有关在贫困图像中使用人工智能的批评

人道组织面临着对其在活动中使用人工智能生成图像的日益增长的批评。这些图像旨在展示贫困和需要帮助的人群,但对于其真实性引发了伦理问题。批评者认为,这种做法扭曲了现实,可能误导潜在的捐助者。

人道机构的新灾害

误导性图像的问题突显了一个令人担忧的现象。一些人道机构利用数字创作来展示困境情况,导致对操纵捐助者情感的指控。这种扭曲的认知可能会对这些依赖公众信任以获取资金的组织的信誉造成潜在危害。

对人道任务的影响

在贫困视觉化中使用人工智能对现场进行的任务带来了直接影响。组织可能会失去来自捐助者的资金支持,捐助者可能会对扭曲的地缘政治现实感到上当。此外,对全球事务的不当沟通可能导致他们的当前任务陷入困境。

迅速而果断反应的必要性

面对这一挑战,迅速和果断反应显得至关重要。组织必须建立严格的协议,以确保使用的图像真实且能代表现实。气候问题和武装冲突使得这一情况更加复杂,透明度更加重要,以维持捐助者的信任。关于人工智能在一个人道框架内影响的分析,请见这里。

人工智能生成的图像对公众感知的影响

人工智能创建的图像可能会很吸引人,但它们对公众感知的影响依然令人担忧。图像易于操控的特性可能导致对真实人类苦难的麻木。清晰性和真实性必须优先,以维持人道组织与公众之间的真实联系。关于这一现象的更多信息,详见这里。

扭曲图像的危险:一个惊人的例子

最近,一段描绘加沙在美好景象下的视频引发了愤怒,凸显了生成图像可能带来的危险。这种表示可能会淡化居民所经历的戏剧性情境,引发公众讨论视觉表现伦理的问题。更多分析可以通过像这篇文章找到。

保护弱势群体的挑战

当人道组织继续为保护弱势群体而斗争时,使用人工智能生成的图像同样引发了对其对所代表人群影响的质疑。错误乐观的图像可能导致错误的政治决策和不恰当的干预。冲突的残酷事实,例如在加沙以色列和哈马斯之间的冲突,要求进行忠实的表现,以激发真正的同情和有效的干预。有关这一悲惨现实的更多信息,请见这里。

关于真实性的重要性结论

对生成的人工智能图像的批评强调了透明沟通策略的重要性。人道组织必须致力于提供真实的信息,以确保捐助者的信任和对人道危机的准确表现。确保忠实的表现也可以增强国际社会对人道挑战的动员。

关于人道组织与人工智能生成贫困图像的常见问题

针对人道组织使用人工智能生成图像的主要批评是什么?

批评通常集中在缺乏真实性、可能对受益者的污名化以及为了提高意识而加剧贫困的趋势,这可能扭曲现实。

人道组织如何避免在表现受益者时去人性化的情况?

通过让当地社区参与内容创作,确保图像反映出人的尊严,以及避免使用与贫困相关的刻板印象。

在人道领域中,是否有关于使用人工智能图像的具体法规或指导方针?

目前尚无普遍适用的立法,但许多组织依赖于伦理指导原则,并与人权倡导团体合作,建立负责任的实践。

人工智能生成的图像是否真的能对公众对人道行动的看法产生积极影响?

是的,若使用得当,人工智能生成的图像可以使人道事业更具人性化,并让受益者的故事更容易被公众接受和关注。

在募捐活动中使用人工智能生成的贫困图像有哪些伦理影响?

伦理影响包括责任地表现受益者,避免情感操控,并确保筹集的资金被合理使用。

人道组织如何平衡人工智能的使用与受益者的真实叙述?

通过采用以人为中心的方法,融入生动的叙事和真实的见证,并将人工智能作为辅助手段,而不是受益者声音的替代品。

人道组织应避免哪些类型的图像,以免降低弱势人群的经历?

应避免表现过度痛苦或负面刻板印象的图像,以及那些利用贫困以引发轰动的内容,以免将个人降格为其处境。

人道组织是否应对使用生成的人工智能图像进行完全透明的承诺?

是的,透明度对于建立公众与受益者之间的信任至关重要,清楚地沟通这些技术的使用及编辑选择十分重要。