アメリカのスタートアップAnthropicは、より安全で透明性のある人工知能の開発を目指しており、最近Googleから20億ドルを調達しました。 この大規模な資金注入は急成長している企業に対する期待感を浮き彫りにし、テクノロジー業界の巨人たちが人工知能分野の進歩を望みつつ、内在するリスクを最小限に抑えようとする姿勢を示しています。重要な問題は、これらの投資やAnthropicのような企業がAIに関連する危険を制御するために講じている措置が、急速に進化する先進的なAIに対して私たちの安全を確保するのに十分なのかということです。

ChatGPTの出現とAIの未来への影響

ChatGPTなどの会話型システムでの最近の進展は、人々に興奮と不安の両方を引き起こしています。この技術は、スピーチの作成、休暇の計画、人間と同じくらい好ましく、時にはそれ以上に会話をする能力を持っており、その多才さと力強さが称賛されています。しかし同時に、高度なAIの潜在的に破壊的な能力や、これらのツールをどのように制御できるかについての問題も浮上しています。

警鐘を鳴らす

英国政府や大手AI企業などの主要な業界関係者は、先進的なAIの未知の危険についてすでに警告を発しています。 これらの懸念は、悪意のある行為者が有害な目的のために人工知能システムを悪用する可能性、すなわち誤情報や大衆操作に関するものです。 この分野の進展は避けられませんが、それが人類にとって脅威となることがないようにすることは不可欠です。

Anthropicのアプローチ:慎重さと透明性

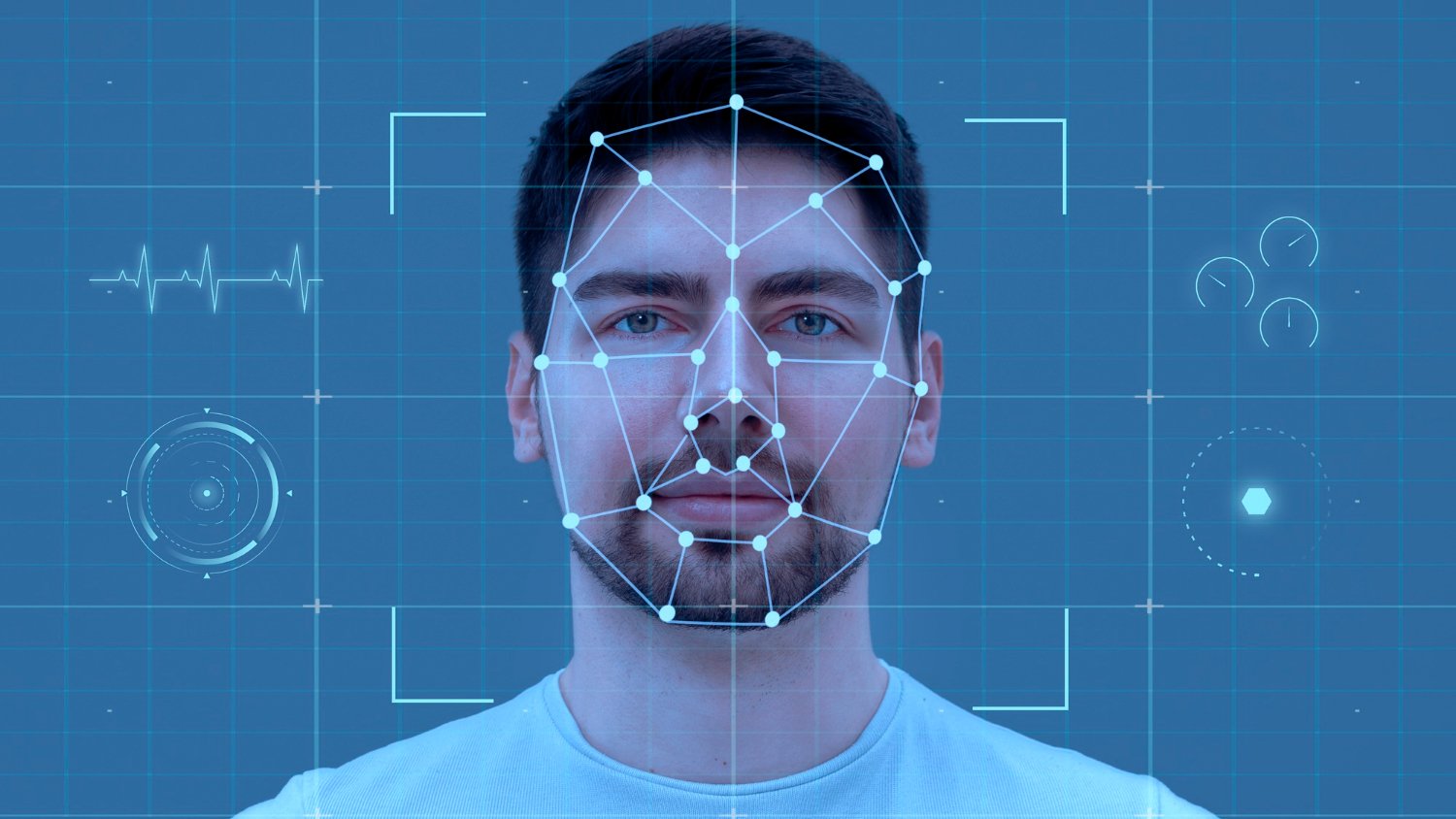

この観点から、Anthropicは単に人工知能の能力を向上させるだけでなく、強固な研究開発の枠組みに基づいてその安全性を確保することを目指しています。彼らの優先事項の一つは、AIが自らの行動について明確で正確で理解しやすい説明を提供できることを保証し、人間により高い判断力を持たせ、機械の予測のみに基づく判断ミスを制限することです。 Googleから受け取った substantial financing は、Anthropicが研究を迅速に進め、AIの創作物にさらなる制御措置を組み込むことを可能にするでしょう。 しかしながら、この大規模な投資は、人工知能の開発における大手テクノロジー企業の責任の割合およびそれに起因する危険についての疑問も提起します。

AIの覇権を巡る過酷な競争

テクノロジー企業間に競争が生じていることは否定できず、すべてが市場により高度で性能の高いAIを提供しようとしています。この激しい競争は、無謀なリスクを取ったり、開発の速度を優先して注意を怠ったりすることを促すかもしれません。したがって、Anthropicのみならず、OpenAIやその他の業界関係者も、自らの仕事に潜む可能性のある危険に対して警戒を怠らないことが重要です。

人工知能の台頭に対する集合的責任

最終的には、すべての利害関係者、すなわちスタートアップ、政府、テクノロジー企業、研究者が、先進的なAIの創造における行動の意味を注意深く検討する責任があります。GoogleによるAnthropicへの投資が研究のために有用であり、私たちが希望するようにAIに関連するリスクの管理につながるとしても、それが全てではありません。 すべての人が自分の責任を果たし、AIの進展が本当に人類の利益に役立ち、同時に副次的な被害を抑えることを保証しなければなりません。 今後の進展は、主要な利害関係者間での継続的な対話とアイデアの共有を必要とします。人工知能の成功は、私たちの協力、革新、そして未来の意思決定に倫理を根底に置く能力に大きく依存するでしょう。